:quality(75)/2021_6_21_637598743913660081_ios-15-live-text-vs-google-lens-android-12-cover.jpg)

So sánh tính năng Live Text trên iOS 15 và Google Lens trong Android 12

Một trong những cải tiến quan trọng trong hệ điều hành iOS mới là khả năng trích xuất văn bản ra khỏi ảnh. Được gọi là Live Text, iOS 15 giúp bạn dễ dàng lấy được số điện thoại hoặc truy cập trang web trực tiếp từ máy ảnh của mình. Các thiết bị Android đã có tính năng này khá lâu, được gọi là Google Lens.

Vậy Live Text trong iOS 15 khi so với Google Lens trên Android 12 sẽ như thế nào? Tính năng nào sẽ hoạt động tốt hơn? Hãy cùng FPTShop tìm câu trả lời qua bài viết dưới đây.

Sau khi thực hiện bài so sánh giữa Siri trong iOS 15 và trợ lý ảo Google trên Android 12 vào tuần trước, YouTuber In Depth Reviews vừa tiếp tục đăng một video so sánh Live Text trong iOS 15 với Google Lens trên Android 12. Trước khi xem kết quả thử nghiệm, cần lưu ý rằng hệ điều hành iOS 15 hiện đang trong giai đoạn thử nghiệm, do đó Apple chắc chắn sẽ mang đến nhiều cải tiến trước khi phát hành bản chính thức cho người dùng.

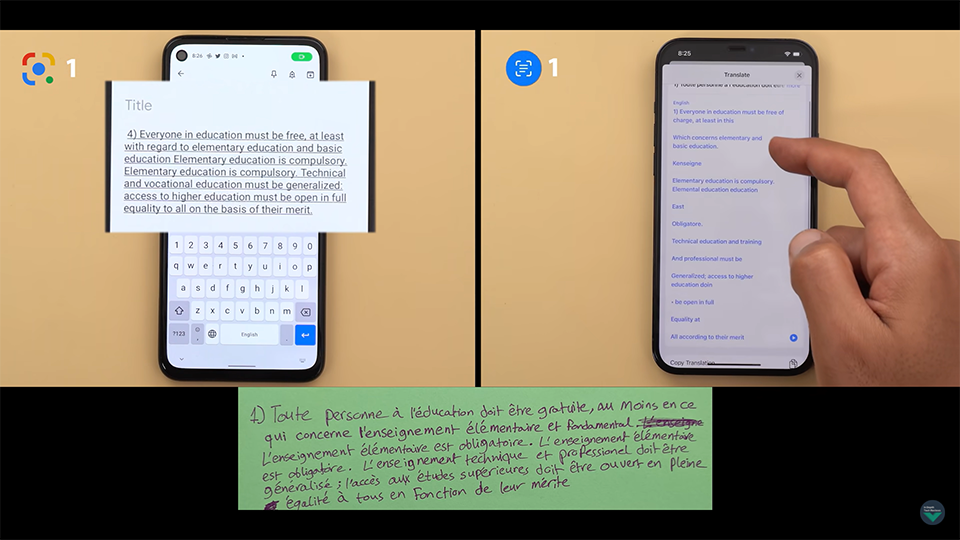

Nhận dạng văn bản

Theo trang iPhonehacks, YouTuber In Depth Reviews đã chia bài kiểm tra thành 3 phần. Điều đầu tiên và cũng là điều quan trọng nhất, là tính năng nhận dạng văn bản hoạt động tốt như thế nào trên cả hai.

Kết quả cho thấy iOS 15 có hệ thống nhận dạng văn bản tốt hơn vì bạn có thể trực tiếp tìm kiếm văn bản từ Spotlight - không cần phải truy cập vào hình ảnh và chọn văn bản. Thay vào đó, bạn có thể trực tiếp làm điều đó bằng cách nhập trực tiếp văn bản bạn đang tìm kiếm vào Spotlight.

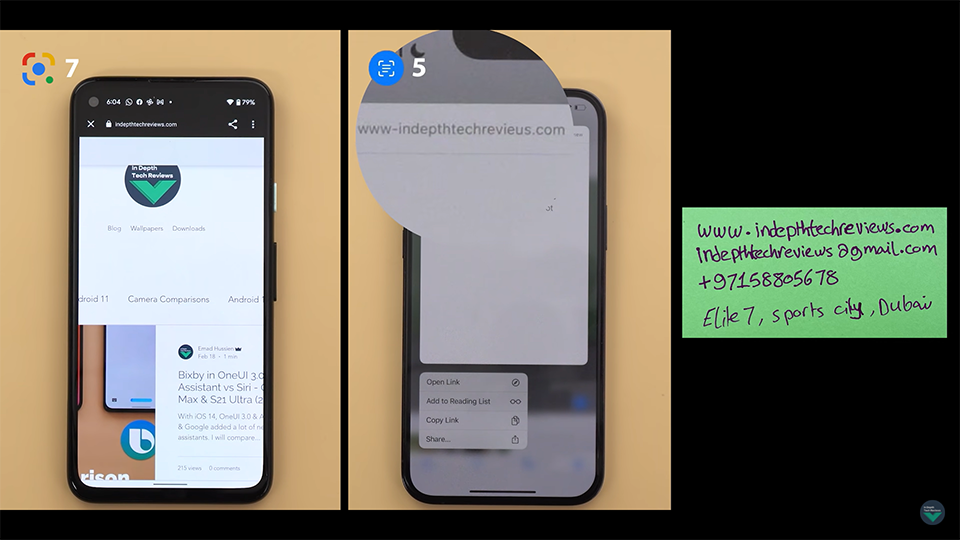

Khi trích xuất thông tin từ hình ảnh có văn bản được đánh máy, chẳng hạn như danh thiếp hay sách, cả Google Lens và Live Text đều hoạt động tốt. Tuy nhiên, trong việc trích xuất văn bản từ các hình ảnh viết tay, Google Lens cho kết quả tốt hơn. Nhìn chung, cả hai tính năng này đều hoạt động khá tốt và chắc chắn sẽ khiến người dùng hài lòng.

Dịch văn bản

Khi dịch văn bản từ hình ảnh được chụp từ máy tính, cả Google Lens và Live Text đều hoạt động tốt. Tuy nhiên, một lần nữa Google Lens đã dịch văn bản tốt hơn từ các hình ảnh viết tay.

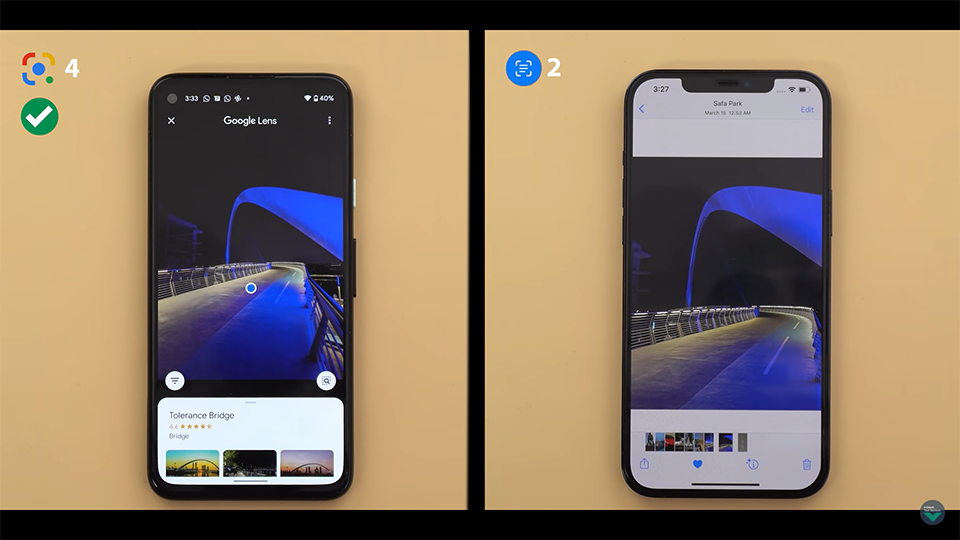

Tra cứu trực quan

Tra cứu trực quan là một tính năng trong iOS 15 cung cấp cho bạn thông tin của một mốc trực tiếp từ ứng dụng Ảnh. Google Lens đã có thể làm điều này với khả năng tìm kiếm các đối tượng được bổ sung.

Đúng như mong đợi, Google Lens đã hoạt động tốt hơn vì hiện tại, có vẻ như tính năng Live Text trên iOS 15 vẫn chưa hoàn thiện vì nó vẫn chưa nhận dạng được các đối tượng. Ngay cả khi trích xuất các địa danh từ một hình ảnh, LiveText đã mắc lỗi khi xác định cầu Tolerance của Dubai là cầu Thiên niên kỷ của thành phố New Castle, Anh.

Qua thử nghiệm này, rõ ràng là Live Text hiện vẫn đang trong giai đoạn thử nghiệm và hoạt động chưa thật sự ổn định. Apple sẽ tinh chỉnh phần mềm hơn nữa trong những ngày tới và nó sẽ hoàn thiện hơn khi bản iOS 15 chính thức được phát hành cho người dùng vào cuối năm nay.

:quality(75)/estore-v2/img/fptshop-logo.png)

:quality(75)/2021_6_16_637594784608261638_so-sanh-cover.jpg)

:quality(75)/2021_6_17_637595653801629341_siri-ios-15-vs-google-assistant-android-12-cover.jpg)

:quality(75)/2021_6_20_637598170622527594_tren-tay-meizu-watch-cover.jpg)